1 – Recherche Scientifique : Modéliser l’interaction

En s’appuyant sur les théoriciens de l’improvisation musicale, le philosophe Yves Citton explique que les actions individuelles au sein des interactions collectives de la vie sociale et politique résultent d’une association d’improvisation à la volée (on-the-spot improvisation) – grâce à laquelle il est possible d’intégrer la nouveauté de chaque situation– et d’anticipation compositionnelle (compositional foresight) – grâce à laquelle l’agent anticipe les conséquences de son comportement présent selon sa compréhension rationnelle des lois gouvernant le contexte[1]. Pour produire de l’organisation créative– par exemple une réalisation collective à la fois structurée et spontanée– le défi posé aux systèmes cyber-humains[2] est donc celui de savoir entrelacer dans les processus de décision différentes échelles de perception, d’entendement et de projection temporelle, nécessitant de bénéficier de capacités fines d’appréhension et d’élucidation du comportement collectif. Ainsi, de la négociation entre réaction instantanée aux stimuli, projection des intentions individuelles à moyen-terme, et prédiction de l’évolution de l’organisation globale pourront naître des interactions collectives riches et porteuses de sens.

La performance artistique improvisée pour sa part consiste à mobiliser une mémoire (l’expérience pratique et les connaissances) et une spécialisation individuelle (e.g. être soliste) dans la production structurée d’un discours colllectif performatif (e.g. la musique) en articulant les projections individuelles (les intentions) avec des prédictions à plusieurs échelles de temps basées sur l’écoute des structures formelles émergeant du collectif (e.g. une progression harmonique ou l’amorce d’une fin possible). L’incertitude des acteurs varie selon le degré de conventions consenties au départ (e.g. improvisation libre, référence commune à un standard comme dans le jazz) conditionnant les connaissances à priori engagées dans la transaction. La conception d’agents pour la co-créativité cyber-humaine dans un contexte d’improvisation constitue donc un terrain idéal de modélisation et d’expérimentation pour traiter d’interactions collectives hybrides, combinant liberté et coopération constructive.

La recherche dans laquelle s’inscrit l’installation C’est pour quoi offre une alternative aux visions « remplacistes » des agents créatifs autonomes ou technologiques cantonnant la machine au rôle d’outil subordonné à des objectifs fixés a priori.Cette troisième voie est celle d’un compagnonnage humain-machine pour la co-construction et le partage d’objectifs élaborés dynamiquement. L’application de techniques d’intelligence artificielle se développe jusque chez des acteurs industriels majeurs (Google Magenta, Sony CSL, Spotify) pour la composition musicale hors-temps, mais notre approche spécifique sur l’interaction collective temps-réelle est un domaine peu abordé nécessitant une expertise approfondie des problématiques scientifiques et musicales sous-jacentes, et l’intégration de collaborations poussées avec des musiciens experts. Ce projet associera la créativité computationelle, le traitement du signal, l’apprentissage automatique, la planification, les architectures multi-agents, et les sciences sociales pour converger vers un modèle général d’agent impliqué dans une interaction collaborative.

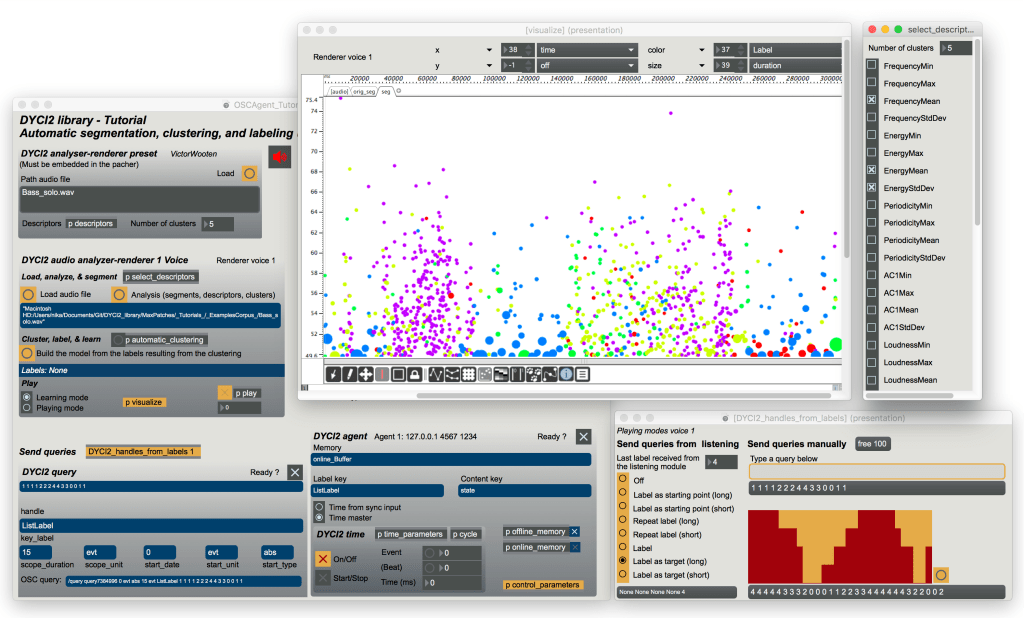

Le projet vise à établir un cadre pour la modélisation et l’expérimentation relatives aux interactions collectives et co-créatives impliquant agents humains et artificiels, en prenant la performance artistique improvisée comme objet central. Il modéliserala réalisation spontanée d’une organisation collective complexe par des agentsaux modèles de perception, de découverte, de génération et de contrôle aux temporalités multiples, et dont les processus de décision entrelacent écoute de signaux multivariés, réaction à l’imprévu, intentions individuelles, et anticipation de structures sous-jacentes dans le comportement collectif. Il aboutira au développement d’« agents/instruments » informatiques génératifs capables de mobiliser un corpus multimédia appris en amont ou en temps réel pour contribuer à l’élaboration d’une œuvre collective scénarisée en amont ou dont la structure temporelle est définie au cours même de la performance ou de l’installation.

Nous mettrons en place des processus génératifs temps-réel informés par des structures temporelles permettant un apprentissage des entrées pour nourrir un modèle de mémoire. Ces modèles s’enrichiront d’une capacité à être guidés par des spécifications temporelles court-termes tout en combinant cette planification avec une influence locale d’évènements complexes non-ordonnés. Nous concevrons des modèles d’agents intégrant des modules d’écoute, de décision, et de génération. Tout d’abord, une architecture d’agent informé par une écoute multimodale (e.g. flux audios et gestuels). Les modules décrits précédemment serviront de composants pour modéliser le processus de décision par la négociation entre réaction instantanée, projection des intentions, et prédiction. Nous déclinerons ce modèle d’agent en tant qu’instrument conscient de son environnement et « jouable » par un opérateur.

Les recherches seront menées en collaboration avec des musiciens experts, et seront validées et affinées au cours de séances d’expérimentation mêlant sessions de travail en situation « d’observation participante », concerts, entretiens, et réécoute critique.

[1] Citton. “Politics as hypergestural improvisation in the age of mediocracy”. In George E. Lewis and Benjamin Piekut, editors, The Oxford Handbook of Critical Improvisation Studies. Oxford University Press, 2013.

[2] De la même manière que cyber-physique caractérise le continuum entre l’algorithme et le monde physique, nous appelons cyber-humain le continuum entre l’algorithme et l’humain (son psychisme et son comportement).

2 – Recherche artistique : composer l’interaction

L’hippocampe est un élément du cerveau responsable de la coordination à haut niveau des processus liés à la mémoire. Impliqué en amont comme en aval, c’est un acteur de l’acquisition de la mémoire comme de son exploitation : il pilote la découverte de nouveautés dans les perceptions, l’encodage de ces informations, leur stockage, et à l’autre bout de la chaîne, la mobilisation de ces données. En effet, c’est également l’hippocampe qui nous permet de nous « rejouer des scènes» en réactivant certains schémas d’activités dans différentes régions du cerveau.

L’ « Hi A» ou « Hippocampe Artificiel» est une métaphore parfaite pour décrire le travail que je mène depuis quelques années aussi bien avec Rémi Fox qu’avec Steve Lehman, et en particulier le rôle qu’y tient la technologie :

- nos improvisations sont le produit de parcours interactifs et créatifs de mémoires musicales, de la même manière que l’hippocampe est mis à contribution durant les rêves en tant que chef d’orchestre d’une réinterprétation créative de la mémoire ;

- les instruments logiciels que nous développons sont eux aussi impliqués dans la chaîne entière du traitement de la mémoire (de l’acquisition à la réinterprétation, en passant par l’encodage et l’apprentissage).

Ces instruments logiciels naviguent dynamiquement dans des modèles informatiques de mémoires musicales, c’est-à-dire des enregistrements audios, afin d’y collecter de très courtes portions de musique qui sont ré-agencées et assemblées pour créer des phrases musicales nouvelles. L’exploration musicale rendue possible par ces « Hi A» est celle de l’invention de nouvelles pratiques d’improvisation. Nous décrivons dans cette section les principaux enjeux artistiques qui en émergent : la composition du matériau, l’improvisation musicale et le développement d’une troisième voix littéralement créée par l’interaction.

Composer les mémoires, improviser la structure.

L’hippocampe encode les informations destinées à être stockées mais la sélection des informations à conserver est faite en amont. De la même manière, la sélection des mémoires musicales de nos « Hi A» tout comme la composition des mécanismes d’écoute sont des choix compositionnels humains (par exemple : utiliser comme mémoire des pistes audio de batterie, et générer en temps réel une batterie qui suivra les nuances du saxophone). Plus précisément, nous souhaitons travailler sur la combinaison de mémoires aux temporalités multiples au sein d’une même performance :

- la mémoire à long-terme : de la musique venant d’ailleurs ou des textures que nous aurions nous-même enregistrées au préalable (par exemple, des polyphonies taiwanaises ou des batteries dans les extraits 1, 4, et 5 de la playlist suivante : https://www.youtube.com/playlist?list=PL-C_JLZNFAGd4W0IDFqY5oE2_EJVR9Evz) ;

- la mémoire immédiate ou à court-terme : une mémoire constituée du jeu du saxophone qui est capté en temps réel et enregistré au cours même de la performance (par exemple dans l’extrait 6 de la playlist1);

- les souvenirs : une mémoire de ce que l’interaction avait produit lors de sessions d’improvisations passées (par exemple dans les extraits 2 et 3 de la playlist citée plus haut)..

La première intention artistique de notre projet est d’expérimenter une pratique hybride de création dans laquelle la mémoire est composée et la forme est improvisée. Une pièce se définira donc par ses mémoires et/ou ses mécanismes d’acquisition de mémoire et aura une infinité de déclinaisons car la structure sera générée par l’interaction pure. Les pièces développeront une esthétique électronique tout en cherchant à préserver le caractère organique des enregistrements utilisés : chœurs traditionnels, voix parlées, instruments acoustiques,souffles, modes de jeu bruitistes, etc.

Intentions humaines, intelligence artificielle… d’exécution.

L’application artistique de techniques d’ IA (intelligence artificielle) se développe jusque chez des acteurs industriels majeurs (Google Magenta, Sony CSL, Spotify) pour la composition musicale. Or, notre approche spécifique sur l’interactionimprovisée en temps réelest un domaine peu abordé.Le graal des industries qui se sont emparées des questions de « créativité artificielle » serait de pouvoir reproduire de la musique à l’infini. Notre projet est au contraire de créer de la musique singulière à l’aide d’instruments intelligents qui sont force de proposition au sein d’un processus créatif humain.

L’hippocampe orchestre la mobilisation de la mémoire pour rejouer ou réinterpréter un souvenir, mais il répond à une intention produite en amont dont il n’est pas l’origine. De la même manière, notre « hippocampe artificiel» présente une intelligence et une créativité d’exécution qu’il met au service des intentions qui, elles, sont bien humaines.

Si nous recherchons cette intelligence d’exécution, c’est qu’elle nous poussera dans les retranchements de l’improvisation. En effet, par la manière facétieuse qu’elle aura de répondre à nos ordres, elle nous rendra simultanément auteur et surpris du discours musical en train de se former. On pourrait par exemple comparer cela à un pianiste qui demanderait à son piano de lui jouer unaccord de la mineuren étant sûr qu’il lui obéira et qu’il choisira une réalisation pertinente de cette consigne… mais sans savoir si son instrument décidera de plaquer l’accord ou s’il fera un arpège, ou encore si la métrique sera ternaire ou binaire.

Meta DJing et développement d’une troisième voix créée par l’interaction.

Au cours de l’improvisation, Jérôme Nika improvise à l’échelle de la narration musicale dans un processus que l’on pourrait qualifier de meta DJing. Il communique ses intentions musicales au systèmeen envoyant des requêtes spécifiant ce que l’instrument électronique doit générer et jouer sur le champ (par exemple : générer et jouer une séquence correspondant à une suite d’accords donnée). Le système trouve immédiatement le meilleur parcours de sa mémoire musicale permettant de collecter des « tranches de musique » satisfaisant cette intention.

Des intentions musicales peuvent également être communiquées par le musicien humain au système, qui réagit en temps réel à son jeu de saxophone. Les mécanismes de réaction peuvent être composés en amont de la performance (en décidant par exemple que le système suivra les hauteurs des notes jouées par le saxophone) ou bien eux-mêmes improvisés de manière collaborative. Il en résulte un large spectre de types d’interaction allantdu dialogue de solistes à l’augmentation du saxophone, en passant par la génération de textures évolutives.

Pour ce faire, les intentions musicales peuvent également provenir d’un contrôle hybride entre le saxophoniste produisant le stimulus et l’opérateur-musicien composant en temps réel les modalités de la réactivité.

Le contrôle sur la génération de l’électronique live est partagé par les musiciens « acoustiques » et « numériques » . La musique qui en résulte est donc véritablement issue en temps réel de l’agrégation des choix des deux membres du duo. Cette pratique brouille les rôles établis de musicien acoustique et musicien électronique. De cette manière, le projet propose une piste de réflexion pour aborder le défi de la musique avec électronique en temps réel : créer un univers homogène dans lequel l’acoustique et l’électronique se nourrissent mutuellement et ne sont pas deux mondes imperméables simplement juxtaposés.